Professional Documents

Culture Documents

Capitulo 6

Uploaded by

Cristhian Silupu CastilloOriginal Title

Copyright

Available Formats

Share this document

Did you find this document useful?

Is this content inappropriate?

Report this DocumentCopyright:

Available Formats

Capitulo 6

Uploaded by

Cristhian Silupu CastilloCopyright:

Available Formats

Cap. 6.- Relacin entre variables.

109

Captulo 6.

RELACIONES ENTRE VARIABLES.

6.1. El coeficiente de correlacin de Pearson.

Definicin.- Es una prueba estadstica para analizar la relacin entre dos variables

medidas en un nivel por intervalos o de razn.

Hiptesis a probar: Correlacional, del tipo A mayor X, mayor Y, A mayor X, menor

Y, Altos valores en X estn asociados con altos valores en Y, Altos valores en X se

asocian con bajos valores de Y.

La prueba en si no considera a una variable como independiente y a otra como

dependiente, ya que no se trata de una prueba que evala la causalidad. La nocin de

causa-efecto (independiente-dependiente) se puede establecer tericamente, pero la

prueba no considera dicha causalidad.

El coeficiente de correlacin de Pearson ( r ), se calcula a partir de las puntuaciones

obtenidas en una muestra en dos variables. Se relacionan las puntuaciones obtenidas de

una variable con las puntuaciones obtenidas de otra variable, en los mismos sujetos.

n

n xi y i ( xi )( y i )

i 1

i 1

n

2

2

2

2

n

x

(

x

)

n

y

(

i i i yi )

i 1

i 1

i 1

i 1

El coeficiente r de Pearson puede variar de 1.00 a + 1.00 donde:

-1.00 = Correlacin negativa prefecta.

-0.90 = Correlacin negativa muy fuerte.

-0.75 =.Correlacin negativa considerable.

-0.50 = Correlacin negativa media.

-0.10 =.Correlacin negativa dbil.

0.00 = No existe correlacin alguna entre las variables.

+0.10 =.Correlacin positiva dbil.

+0.50 = Correlacin positiva media.

+0.75 =.Correlacin positiva considerable.

+0.90 = Correlacin positiva muy fuerte.

+1.00 = Correlacin positiva prefecta.

El signo indica la direccin de la correlacin (positiva o negativa) y el valor numrico,

la magnitud de la correlacin.

6.2. Regresin lineal y correlacin.

Cap. 6.- Relacin entre variables.

110

En muchas aplicaciones estadsticas se deben resolver problemas que contienen un

conjunto de variables y que sabe que existe alguna asociacin entre ellas. En este

conjunto de variables muy a menudo se tiene una sola variable dependiente (o

respuesta) Y, que depende de una o ms variables independientes (o de regresin) X1,

X2, ... , Xk , como por ejemplo el salario, depende de : aos de experiencia, grado de

instruccin y sexo.

La variable dependiente se mide con un error que no se controla en el experimento, por

tanto, Y es una variable aleatoria. Las variables independientes X1, X2, ... , Xk se

miden con un error despreciable, que en la mayora de los casos se controla en el

experimento, y por lo tanto, no tienen la propiedad de ser variables aleatorias.

Existen dos formas distintas pero relacionadas del estudio de la asociacin entre

variables a partir de una muestra aleatoria. La primera forma, es determinar una

relacin funcional de la variable dependiente Y con respecto a una o ms variables

independientes con el fin de predecir valores de Y. Este mtodo es el anlisis de

regresin. La segunda forma de estudio de la asociacin entre variables, es, medir el

grado de relacin entre ellas, mediante un coeficiente o ndice. A esta tcnica se

denomina anlisis de correlacin.

Los mtodos de regresin y correlacin entre variables se clasifican por el nmero de

variables independientes, en simples y mltiple. El anlisis de asociacin se denomina

simple , si hay una sola variable independiente, si hay dos o ms variables

independientes se denomina el anlisis de asociacin Mltiple.

Por el tipo de funcin matemtica que se puede ajustar a los datos, la asociacin de las

variables puede ser lineal o no lineal, como por ejemplo: parbola, polinomio,

exponencial, etc.

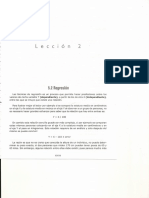

6.2.1.- Modelo de regresin lineal simple.

Consideremos una variable dependiente Y con una sola variable independiente X.

Representemos una muestra aleatoria de tamao n de (X, Y) por el conjunto de pares de

datos: (x i , y i ) / i 1,2,..., n .

Denotaremos por Y/ X la variable aleatoria Y dependiente de X. Su media y varianza se

2

denotan respectivamente por Y / X y por Y / X . En particular el smbolo Y/ xi

representa a la variable aleatoria Yi cuando X = xi .

Supuestos.Los supuestos para el modelo de regresin lineal simple son:

1) Igualdad de varianzas (Homoscedasticidad).

Para cada valor xi de la variable independiente X, la distribucin de la variable aleatoria

2

dependiente Yi tiene media Y/ x y varianza Y / xi . Se supone que cada una de estas

varianzas son iguales a la varianza comn 2 , denominada varianza de la regresin.

i

Cap. 6.- Relacin entre variables.

111

2) Independencia.

Se supone que las Yi son variables aleatorias estadsticamente independientes.

3) Linealidad.

Se supone que la relacin de Y con X es lineal, es decir todas las medias Y/ x deben

estar en una lnea recta denominada lnea de regresin poblacional, cuya ecuacin es,

(ver figura 6.1)

i

Y/X X

Y/X X

ei

ei

Yi

X

X1

X2

X3

X4

Fig. 6.1. Suposiciones en regresin.

En la ecuacin de regresin poblacional los coeficientes de regresin y son

parmetros que se estiman a partir de los datos de la muestra.

El valor de es la ordenada en el origen e indica el valor de Y cuando X = 0. El valor

de es la pendiente de la ecuacin de regresin poblacional e indica el cambio

promedio en Y correspondiente a un incremento unitario en X. El signo de

tambin indica el tipo de tendencia (positiva o negativa ) de Y con respecto a X.

Cada valor individual Yi difiere de la media condicional Y/ x i en el trmino

E i Yi Y / x , denominado error. Las variables Ei , son entonces, variables aleatorias

independientes con media cero y varianza 2. Luego, el modelo de regresin lineal

simple puede ser expresado por:

i

Yi Y / x i E i x i E i

La estimacin de la ecuacin de regresin poblacional Y/X X es la ecuacin de

regresin muestral:

a bX

Y

en donde a y b son las estimaciones de los parmetros y respectivamente.

Cap. 6.- Relacin entre variables.

112

4) Normalidad.

Se supone que cada variable aleatoria dependiente Yi tiene distribucin normal con

media Y/ x y varianza 2. En consecuencia, E i ~ N(0, 2 ) .

i

6.2.2.- El diagrama de dispersin

Es un grfico que permite detectar la existencia de una relacin entre dos variables. Si la

tendencia es lineal se puede ajustar una lnea recta al diagrama de dispersin.

(a) Lineal directa

(b) Lineal inversa

(c) Curvilnea directa

X

(e) Lineal inversa

con ms dispersin

X

(f) Ninguna relacin

Fig. 6.2.- Diagramas de dispersin: Relaciones entre X e Y.

En las figuras (a) , (b) y (e) los datos visualizan una relacin lineal entre las variables X

e Y. En las figuras (c) y (d) los datos visualizan una relacin, pero, una relacin no

lineal, y en la figura (f) los datos visualizan ninguna relacin vlida entre las variables.

6.2.3.- Estimacin de la ecuacin de regresin poblacional.

X

Y

X

(d) Curvilnea inversa

Cap. 6.- Relacin entre variables.

113

La estimacin de la ecuacin de regresin poblacional Y/X X es la ecuacin de

regresin muestral:

a bX

Y

es una estimacin de Y/X , a y b son las estimaciones de los parmetros.

en donde Y

Se denotar por y i el valor de Y cuando X = xi .

a bX , a partir de los datos de la

para determinar la ecuacin de regresin muestral Y

muestra, utilizaremos el mtodo de mnimos cuadrados. Esto es, se deben hallar a y b de

modo que:

n

i 1

i 1

i 1

SCE (Suma de Cuadrados de los Errores) ei2 ( yi y i ) 2 ( yi a bxi ) 2 mnimo

Este requerimiento se cumple, si a y b se determinan resolviendo el siguiente sistema de

ecuaciones normales:

n

yi an b xi

i

x y

i

i 1

n

i 1

i 1

a xi b xi2

n

de donde se obtiene:

i 1

n

i 1

n xi yi xi yi

i 1

n xi2 ( xi ) 2

i 1

i 1

a y bx

El valor constante a de la ecuacin de regresin muestral, es la ordenada en el origen.

cuando X cambia una unidad de

El valor de la pendiente b es el cambio promedio en Y

medicin.

Ejemplo 1.- En la Empresa comercial ABC, se desea determinar la relacin lineal

simple entre la experiencia del vendedor y las unidades vendidas durante un mes. Se

seleccionan 5 vendedores al azar, los datos registrados se presentan a continuacin.

VENDEDOR

CARLOS PEDRO JOSE JUAN MANUEL

EXPERIENCIA

(aos):X

3

1

2

5

4

VENTAS

(unidades) : Y

9

5

7

14

10

a) Trazar el diagrama de dispersin.

b) Determinar la lnea de regresin muestral de mnimos cuadrados.

c) Interpretar el valor de la pendiente.

d) Estimar la venta que correspondera a un vendedor con 6 aos de experiencia.

Cap. 6.- Relacin entre variables.

114

Solucin

Ventas (unidades) Y

a) El diagrama de dispersin es la figura 6.3, obtenida mediante el programa

STATGRAPHICS.

16

14

12

10

8

6

4

2

0

0

2

3

Experiencia (aos) X

Fig. 6.3.

b) De los datos de la muestra resultan:

Experiencia (X)

3

Ventas (Y)

9

X2

9

XY

27

14

14

25

70

4

15

10

45

16

55

40

156

x i 15 ,

i 1

y i 45 ,

i 1

x 3

n

i 1

n

i 1

n x i y i xi y i

i 1

n xi2 ( xi ) 2

i 1

x i2 55

i 1

x y

i 1

y9

5(156) (15)(45)

2.1

5(55) (15) 2

i 1

a y b x 9 2.1 3 2.7

2.7 2.1 X

As, la lnea de regresin estimada o muestral es: Y

156 ,

Cap. 6.- Relacin entre variables.

115

c) El valor b = 2.1 de la pendiente indica que por cada ao de experiencia, la venta se

incrementa en 2.1 unidades.

Nota.- Utilizando el Software Statgraphics versin 5.0, nos proporciona el siguiente

resultado para el mismo ejemplo 1.

Regression Analysis - Linear model: Y = a + b*X

----------------------------------------------------------------------------Dependent variable:

Ventas

Independent variable: Experiencia

---------------------------------------------------------------------------Standard

T

Parameter

Estimate

Error

Statistic

P-Value

----------------------------------------------------------------------------Intercept

2.7

0.834666

3.23483

0.0480

Slope

2.1

0.251661

8.34455

0.0036

----------------------------------------------------------------------------

La salida muestra el resultado de ajustar un modelo lineal para describir la relacin entre

Ventas y Experiencia. La ecuacin del modelo lineal ajustado es:

Ventas = 2.7 + 2.1 * Experiencia

d)

6.2.4.- Estimacin de la varianza de la regresin poblacional 2.

a bX nos interesa saber su

Una vez halada la lnea recta de regresin muestral, Y

utilidad. La utilidad principal es predecir valores de Y para valores determinados de X.

Si se hace prediccin nos interesa saber, qu tan buena o confiable es esa prediccin?.La respuesta a esta pregunta depende de la variabilidad de los valores de Y con respecto

a la recta de regresin.

Una medida que indica el grado de variabilidad o dispersin en torno a la lnea de

regresin es la varianza de la regresin poblacional, que se denota por 2 o por Y2 / X

y se define por:

N

2 E(Y Y/X )

(y

i 1

Y/X ) 2

N

donde N es el tamao de la poblacin. La raz cuadrada es la desviacin estndar de

la regresin en la poblacin.

Una estimacin insesgada de 2 es la varianza de la regresin muestral que se denota

2

Y/X y se define por:

por S2 o

n

SCE

S2

n2

(y

i 1

2

y

i)

n-2

Cap. 6.- Relacin entre variables.

116

en donde el numerador, es la suma de cuadrados de los errores (SCE) alrededor de la

lnea de regresin y el denominador , n-2, representa los grados de libertad.

Para el clculo de S2 se utiliza tambin la siguiente expresin:

S2

SCE

n2

i 1

i 1

i 1

y i2 - a y i - b x i yi

n-2

Y / X , es la desviacin estndar muestral de la regresin. Este

La raz cuadrada S o

valor se denomina tambin error estndar de la estimacin.

Mientras ms pequeo sea el valor de la varianza S2 o de la desviacin estndar S, ms

cercanos a la lnea de regresin estarn los valores de la variable Y. Sin embargo, la

interpretacin ms precisa de la varianza muestral de la regresin se har con el

coeficiente de determinacin.

Ejemplo 2.- Con los datos delejemplo1, calcular la desviacin estndar muestral de la

regresin (el error estndar de estimacin).

Solucin.

5

Del ejemplo1, se obtienen: n = 10, a = 2.7, b = 2.1 ,

y i 45 ,

i 1

x y

i 1

)

(YY

)2

(YY

3

1

2

5

4

9

5

7

14

10

9

4.8

6.9

13.2

11.1

0.0

0.2

0.1

0.8

-1.1

0.00

0.04

0.01

0.64

1.21

5

Y

i 1

S2

(y

i 1

2

y

i)

n-2

El error estndar de estimaciones:

1.90

0.6334

3

0.6334 0.7958

unidades.

Nota.- Utilizando la expresin alternativa para el clculo de S2, resulta:

S2

i 1

i 1

i 1

y i2 - a y i - b x i yi

n -2

156

I 2 1.90

Y

Entonces la varianza estimada es:

n

451 2.7 45 2.1 156 1.90

0.6334

3

3

Cap. 6.- Relacin entre variables.

117

Entonces el error estndar de estimacin es:

0.6334 0.7958

6.2.5 Inferencias acerca de los coeficientes de regresin.

No trataremos las inferencias del parmetro en base al valor de a estimado de la

muestra, por que a menudo carece de importancia prctica pues es la ordenada en el

origen y representa la interseccin de Y cuando X = 0. Nos referiremos a las inferencias

acerca de la pendiente de regresin .

Antes de utilizar la ecuacin de regresin muestral para realizar predicciones, se debe

primero determinar si existe realmente regresin poblacional. Si no existe regresin en

la poblacin, entonces, la pendiente poblacional debera ser igual a cero. Debido a

variaciones muestrales, la pendiente de la regresin muestral b puede asumir valores

positivos o negativos, pero la pendiente poblacional podra ser cero. Si es as, la

ecuacin de regresin muestral no se puede utilizar para hacer preediciones vlidas. A

partir de los datos de la muestra, se va determinar si es igual a cero o no lo es.

Para verificar si = 0 se pueden utilizar tres mtodos: Intervalos de confianza, Prueba

de hiptesis y Anlisis de Varianza (ANVA).

Aqu utilizaremos suposicin 4 hecha en el modelo de regresin poblacional, es decir

que cada variable aleatoria dependiente Yi tiene distribucin normal con media Y/ x y

varianza 2., o que cada E i ~ N(0, 2 ) .

i

Anlisis de varianza para .

El anlisis de varianza es uno de los mtodos que se utiliza probar la significacin de la

ecuacin de regresin muestral. Es una prueba F de alternativa bilateral.

Las hiptesis nula y alternativa en este caso son respectivamente:

H 0 : = 0 contra H 0 : 0

La estadstica F de la prueba se obtiene de la siguiente identidad de sumas de cuadrados:

n

( y

i 1

y )2

( y

i 1

SCT

y i ) 2

SCE

( y

i 1

y )2

SCR

SCT ( y i y ) 2 se denomina suma de cuadrados total, refleja la variabilidad de los

i 1

valores de Y con respecto a la media

y.

SCE ( y i y i ) 2 es la suma de cuadrados de los errores, o no explicada.

i 1

n

SCR ( y i - y ) 2 se denomina suma de cuadrados explicado por la regresin, refleja

i 1

la cantidad de variabilidad de los valores de Y explicada por la recta de regresin.

Cap. 6.- Relacin entre variables.

118

La variable aleatoria F definida por: F

SCR / 1

CMR

~ F(1, n 2)

SCE / (n 2)

CME

Dado el nivel de significacin , y los grados de libertad 1 y (n-2), en la tabla de

probabilidades F, se encuentra el valor critico F ( 1 , 1 , n 2 )

Se rechaza la hiptesis nula H 0 : = 0 , si el valor calculado de F, es mayor que el valor

critico F ( 1 , 1 , n 2 ). No se rechaza H 0 en caso contrario.

La prueba de la hiptesis nula H.0: = 0 se resume en la siguiente tabla de anlisis de

varianza (ANVA):

ANVA para H.0: = 0

Fuente de

variacin

Suma de

cuadrados

Grados de

libertad

Cuadrados

medios

Regresin

SCR

CMR = SCR / 1

F

calculada

Error

Total

SCE

SCT

n-2

n-1

CME.= SCE / (n-2)

CMR

CME

Las sumas de cuadrados se obtienen utilizando las expresiones:

n

SCT y i2 n( y) 2

i 1

SCR b

x y

i 1

n( x )( y)

SCE SCT SCR

Ejemplo 3.- Con los datos del ejemplo 1, mediante el mtodo de anlisis de varianza

probar la significancia de la ecuacin de regresin muestral, al nivel de significancia del

5%.

Solucin .1) Hiptesis : H 0 : = 0 contra H 0 : 0

2) Nivel de significancia : = 0.05

3) Estadstica de prueba : F

CMR

~ F(1, 3) , donde n = 5

CME

4) Regin crtica: Para el nivel de significancia = 0.05 y los grados de libertad 1 y 3,

en la tabla F se encuentra el valor critico F ( 0.95 , 1 , 3 ).= 10.1

Cap. 6.- Relacin entre variables.

119

se rechaza H 0 si el valor calculado de F > 10.1. Se acepta en caso contrario.

5.- Clculos: De los datos se obtiene:

n

SCT y i2 n( y) 2 451 5 (9) 2 46

i 1

SCR b

x y

i 1

n( x )( y) 2.1 156 5(3)(9) 44.1

SCE SCT SCR 46 - 44.1 1.9

La tabla de anlisis de varianza es:

ANVA para H.0: = 0

Fuente de

variacin

Regresin

Suma de

cuadrados

44.1

Grados de

libertad

1

Error

Total

1.9

46.0

3

4

Cuadrados

medios

CMR = 44.1

CME = 0.6334

F

calculada

F = 69.624

6.- Decisin.- Dado que F = 69.624 > 10.1, se rechaza H 0. Estos resultados reflejan la

validez del modelo de regresin poblacional entre aos de experiencia y ventas.

Nota.- Observar que la estimacin de la varianza 2 es S2 = CME = 0.6334.

Nota.- Mediante el paquete Estadstico Statgraphics, resulta el siguiente anlisis de

varianza para = 0.

Analysis of Variance

---------------------------------------------------------------------------Source

Sum of Squares

Df Mean Square

F-Ratio

P-Value

---------------------------------------------------------------------------Model

44.1

1

44.1

69.63

0.0036

Residual

1.9

3

0.633333

---------------------------------------------------------------------------Total (Corr.)

46.0

4

Puesto que el valor P-value = 0.0036 < 0.05, se concluye que existe una relacin

estadsticamente significativa entre Ventas y Experiencia en los vendedores.

6.2.5.1. Intervalo de confianza para la prediccin.

Despus de haber decidido que existe regresin lineal simple poblacional o que la lnea

de regresin muestral es vlida para realizar predicciones, podemos utilizarla para:

i)

Predicir la media Y/X , dado X = xo , o

ii)

Predecir una nueva observacin de Y dado un valor xo de X.

Cap. 6.- Relacin entre variables.

120

Intervalo de confianza de Y/X

o el valor de Y0 a bX ,

Sea Y/X o el valor de la media Y/X cuando X = xo y sea y

o es un valor de la variable Y0 a b(x o ) ).

cuando tambin X = xo (es decir y

El intervalo de confianza del (1- ) x100% para la respuesta media Y/X o se obtiene

mediante:

1 ( x0 x) 2

1 ( x0 x) 2

y 0 t ( / 2,n 2) S n

Y / x0 y 0 t ( / 2,n2) S n

n

n

2

( xi x)

( xi x) 2

i 1

Aqu,

(x

i 1

i 1

x) 2 xi2 n( x) 2

i 1

Intervalo de confianza para y0

o el valor

Sea y0 el valor individual de la variable Y0 (xo ) , cuando X = xo y sea y

de Y0 a bX , cuando X = xo.

El intervalo de confianza del (1- ) x100% para una sola respuesta y0 se obtiene

mediante:

y 0 t (1 / 2,n 2) S 1

( x x) 2

( x x) 2

1

1

n 0

y 0 y 0 t (1 / 2,n 2) S 1 n 0

n

n

( xi x) 2

( xi x ) 2

i 1

i 1

Ejemplo 4. Con los datos del ejemplo 1, determinar:

a) El intervalo de confianza del 95% para la respuesta media Y/X o cuando x0=6.

b) El intervalo de confianza del 95% para una sola respuesta y0 cuando x0=6.

6.2.6.- Correlacin.- La medida del grado de asociacin entre dos variables se

denomina coeficiente de correlacin simple. El coeficiente de correlacin poblacional

entre una sola variable independiente y la variable dependiente se representa por . Los

supuestos son los siguientes:

1.- Tanto X como y son variables aleatorias. No tienen que ser designadas como

dependientes o independientes.

2.- La poblacin bivariante es normal. Una poblacin normal bivariante es aquella en la

que X e Y estn distribuidas normalmente. Las medias respectivas son X , Y , y 2X ,

2Y .

3.- La relacin entre X e y es lineal.

Coeficiente de determinacin

Cap. 6.- Relacin entre variables.

121

El coeficiente de determinacin poblacional se denota por 2 y se define en la forma :

2Y / X

2

1 2

X

2

en donde: Y / X denotada tambin por 2 es la varianza de la regresin lineal y , 2Y

es la varianza de Y.

Dado que 2Y / X < 2Y , se tiene que : 0 2 1.

Cuando 2 = 0 , la recta de regresin es horizontal y por tanto no se puede predecir Y a

partir de X. Cuando 2 = 1, hay relacin lineal perfecta entre X e Y.

Coeficiente de determinacin muestral

Para datos muestrales, el coeficiente de determinacin se denota por R 2. A partir de la

particin de suma de cuadrados:

SCT = SCR + SCE

R2 1

Se define por:

-

SCE

SCT

Cuando n es pequeo, el coeficiente de determinacin R2 es sesgado

positivamente. Para corregir este sesgo se calcula el coeficiente de

determinacin ajustado R 2 que se define por :

R2 1

CME

CMT

donde CME = SCE / (n - 2) y CMT = SCT / (n 1).

Cuando se halla la ecuacin de regresin, es aconsejable calcular ambos coeficientes de

determinacin : R2 y R 2 .

Ejemplo 4.- Con los datos del ejemplo 1, calcule el coeficiente de determinacin R2 .

Interprete su resultado.

Solucin. Del ejemplo 1 resultan:

SCT = 46.0 ,

SCE = 44.1 ,

SCE = SCT SCR = 46.0 44.1 = 1.9

Entonces:

R2 1

R2 1

SCE

1 .9

1

0.9587

SCT

46.0

CME

1.9 / 3

1

0.9450

CMT

46.0 / 4

Cap. 6.- Relacin entre variables.

122

El valor de R2 y R 2 se interpretan en la misma forma. As, R2 = 0.9587, significa que el

95.87% de la variacin de la variable dependiente (Ventas) es explicada por la regresin

lineal. Otra forma de interpretar es que el ajuste de la recta de regresin a los puntos de

la muestra es muy bueno.

Nota.- Mediante el software Statgraphics, se obtiene el siguiente resultado:

Correlation Coefficient = 0.97913

R-squared = 95.8696 percent

R-squared (adjusted for d.f.) = 94.4928 percent

Standard Error of Est. = 0.795822

El valor del coeficiente de correlacin r = 0.97913, indica a una relacin relativamente

fuerte entre las variables (Experiencias y Ventas).

Este resultado, tambin nos proporciona el error estndar de estimacin igual a

0.795822.

Analysis of Variance

----------------------------------------------------------------------------Source

Sum of Squares

Df Mean Square

F-Ratio

P-Value

----------------------------------------------------------------------------Model

529.717

1

529.717

226.82

0.0000

Residual

18.6832

8

2.3354

----------------------------------------------------------------------------Total (Corr.)

548.4

9

Correlation Coefficient = 0.982818

R-squared = 96.5931 percent

6.2. - Tablas de contingencia y pruebas Chi-cuadrado.

Bsicamente una tabla de contingencia se obtiene al registrar los datos observados de la

muestra aleatoria en doble clasificacin.

Una tabla de contingencia de r filas (o renglones) y c columnas, denominada tambin

tabla de contingencia de dimensin r x c, contiene en cada celda la frecuencia observada

de la muestra que corresponde a dos variables clasificadas por categoras.

En las pruebas de hiptesis con tablas de contingencia, no se hace ninguna suposicin

acerca de la distribucin de probabilidades de los datos. Con las tablas de contingencias

se ejecutara la prueba de hiptesis: Prueba de independencia de dos variables

estadsticas.

Prueba de independencia.

El procedimiento dela prueba Chi-cuadrado se utilizar para probar la independencia de

dos variables categricas. Las pruebas de hiptesis de independencia implican dos

variables categricas y lo que se prueba es la suposicin de que las dos variables son

estadsticamente independientes.

Cap. 6.- Relacin entre variables.

123

Para cada frecuencia observada en una celda hay una frecuencia esperada que se calcula

a partir de la hiptesis nula especificada y que se supone verdadera.

La prueba.

La hiptesis nula Ho, consiste en suponer que las dos variables categricas son

independientes o que los mtodos de clasificacin de filas y de columnas son

independientes.

La frecuencia esperada correspondiente en cada una de las rc celdas se obtiene mediante

la expresin:

Frecuencia Esperada

total de fila i total de columna j

n

Con las frecuencias observadas 0i y las frecuencias esperadas ei , se calcula la

Estadstica:

(o ei ) 2

2

cal

i

ei

i

en donde la suma se extiende a todas las rc celdas en la tabla de contingencia r x c.

Dado un nivel de significancia , en la tabla chi-cuadrado con (r-1)(c-1) grados de

2

libertad se encuentra el valor crtico 1 , (r 1 )(c 1 ) .

2

2

Si cal 1 , (r 1 )(c 1 ) , se rechaza Ho, en caso contrario se aceptar Ho.

Nota.- Cuando la muestra es pequea, digamos menor de 50, o cuando algunas o todas

la s frecuencias esperadas de las celdas son menores que 5, o cuando el grado de

libertad es igual a 1, debe aplicarse la correccin de Yates. El calculo de Chi-cuadrado

corregida por Yates se efecta por:

( oi ei 0.5 ) 2

2

cal

ei

i

Nota.- Mtodo del valor P en la prueba.

En los software estadsticos se obtiene el valor P (P-value), probabilidad conocida

como la significacin de la prueba. El mtodo del valor P, es otra forma de establecer la

2

2

regla de decisin, cuyo clculo se determina como: P P cal .

Si el valor de P < , se rechaza Ho, en caso contrario se acepta Ho.

Ejemplo 5.- En un proceso de produccin se registro el numero de objetos defectuosos

clasificados por turnos de produccin y por mquinas de produccin. Las frecuencias

observadas se registran en la siguiente tabla de contingencia 3 x 3 . Verificar al nivel de

significancia =0.05 si el numero de objetos defectuosos producidos por las mquinas

es independiente de los turnos de produccin.

Tabla de contingencia 3 x 3.

Mquina

Cap. 6.- Relacin entre variables.

Turnos)

124

Total

Maana

75

90

85

250

Tarde

70

85

70

225

Noche

95

85

75

255

Total

240

260

230

730

Solucin.

1.- Hiptesis:

Ho: El nmero de objetos defectuosos producidos por las mquinas no depende de

los turnos.

H1: El nmero de objetos defectuosos producidos por las mquinas si depende de

los turnos.

2.- Nivel de significancia.- =0.05

3.- Estadstica de prueba.- Se utilizar el estadstico chi cuadrado:

2

cal

(o i ei ) 2

ei

i

que se distribuye aproximadamente como chi-cuadrado con (r-1)x(c-1) =(3-1) x (3-1) = 4

grados de libertad.

4.- Regin crtica.- Para el nivel de significancia =0.05 y con 4 grados de libertad, en

2

la tabla chi cuadrado se encuentra el valor crtico 0.95, 4 9.49 . Se rechazar H 0 si

2

el valor calculado cal es mayor que 9.49.

5.- Clculos.- Las frecuencias observadas y las esperadas (parntesis) se dan en la

siguiente tabla.

Frecuencias observadas y esperadas.

Mquina

Total

Turnos)

A

Cap. 6.- Relacin entre variables.

125

Maana

75 (82.19)

90 (89.04)

85 (78.77)

250

Tarde

70 (73.97)

85 (80.14)

70 (70.89)

225

Noche

95 (83.84)

85 (90.82)

75 (80.34)

255

Total

240

260

230

730

Luego,

2

cal

(oi ei ) 2 (75 82.19) 2 (90 89.04) 2 (85 78.77) 2

ei

82.19

89.04

78.77

(95 83.84) 2 (85 90.82) 2 (75 80.34) 2

3.87

83.84

90.82

80.34

6.- Decisin.- Dado que 3.87 < 9.49, no se rechaza H 0 , y se concluye que el nmero

de objetos defectuosos producidos por las mquinas no depende de los turnos.

Nota.- Mediante el software Estadstico Statgraphics, da como salida la siguiente tabla

de contingencias 3x3.

Frequency Table

Maana

Tarde

Noche

Column

Total

Mquina 1

Mquina 2

Mquina 3

---------------------------------------|

75 |

90 |

85 |

|

82.19 |

89.04 |

78.77 |

---------------------------------------|

70 |

85 |

70 |

|

73.97 |

80.14 |

70.89 |

---------------------------------------|

95 |

85 |

75 |

|

83.84 |

90.82 |

80.34 |

---------------------------------------240

260

230

Row

Total

250

225

255

730

Cell contents:

Observed frequency

Expected frequency

Para realizar la misma prueba de hiptesis de independencia, el estadstico de prueba

Chi-cuadrado, se tiene el siguiente resultado:

Cap. 6.- Relacin entre variables.

126

Chi-Square Test

-----------------------------------------Chi-Square

Df

P-Value

-----------------------------------------3.87

4

0.4242

------------------------------------------

Dado que el P-value = 0.4242 >0.05, no se rechaza H 0 , y se concluye que el nmero de

objetos defectuosos producidos por las mquinas no depende de los turnos.

You might also like

- Perfil de Investigacion CoDocument5 pagesPerfil de Investigacion CoCristhian Silupu CastilloNo ratings yet

- 8 - Prevención de Lavado de Activos - 2017Document9 pages8 - Prevención de Lavado de Activos - 2017CARLOS MUNIVE GARCÍANo ratings yet

- Adopcion Niif LamDocument12 pagesAdopcion Niif LamAle CarpNo ratings yet

- 6 - Sistema Privado de PensionesDocument18 pages6 - Sistema Privado de PensionesCARLOS MUNIVE GARCÍANo ratings yet

- Diagrama de FlujosDocument1 pageDiagrama de FlujosCristhian Silupu CastilloNo ratings yet

- ¡Nvestigación Cualitativa en AdministraciónDocument3 pages¡Nvestigación Cualitativa en AdministraciónCristhian Silupu CastilloNo ratings yet

- Capitulo 3 - Costos IIIDocument4 pagesCapitulo 3 - Costos IIICristhian Silupu CastilloNo ratings yet

- Proyectos de InversionDocument27 pagesProyectos de InversionCristhian Silupu CastilloNo ratings yet

- Plan de Negocios SimplificadoDocument3 pagesPlan de Negocios SimplificadoCristhian Silupu CastilloNo ratings yet

- Analisis Grupo 13Document7 pagesAnalisis Grupo 13Cristhian Silupu CastilloNo ratings yet

- Probab I Lida DesDocument27 pagesProbab I Lida DesCristhian Silupu CastilloNo ratings yet

- Metaforas y Pergaminos de Miguel Angel CornejoDocument67 pagesMetaforas y Pergaminos de Miguel Angel CornejoRodmy CespedesNo ratings yet

- Caso KR UNPDocument19 pagesCaso KR UNPCristhian Silupu CastilloNo ratings yet

- Mentoring Trabajo de AdministracionDocument17 pagesMentoring Trabajo de AdministracionCristhian Silupu CastilloNo ratings yet

- El Sistema Nacional de ContabilidadDocument2 pagesEl Sistema Nacional de ContabilidadJessica Verastegui ValeroNo ratings yet

- Introducció Tesis PymesDocument2 pagesIntroducció Tesis PymesCristhian Silupu CastilloNo ratings yet

- Monografia Del BullyingDocument36 pagesMonografia Del BullyingCristhian Silupu Castillo70% (10)

- Por Qué Han Bajado Los Precios Del PetróleoDocument4 pagesPor Qué Han Bajado Los Precios Del PetróleoCristhian Silupu CastilloNo ratings yet

- Empowermen, Kaizen Y Benchmarking en La Administración de PersonalDocument43 pagesEmpowermen, Kaizen Y Benchmarking en La Administración de PersonalCristhian Silupu CastilloNo ratings yet

- Empresa PesqueraDocument73 pagesEmpresa PesqueraCristhian Silupu CastilloNo ratings yet

- Tesis de Control InternoDocument72 pagesTesis de Control InternoMixiRCNo ratings yet

- Costos 2Document13 pagesCostos 2Cristhian Silupu CastilloNo ratings yet

- Terrorismo en El PeruDocument5 pagesTerrorismo en El PeruCristhian Silupu CastilloNo ratings yet

- Crea Tu EmpresaDocument6 pagesCrea Tu EmpresaCristhian Silupu CastilloNo ratings yet

- Costos Vazquez Unidad 5 - Cap XXI Costos para La Toma de DecisionesDocument22 pagesCostos Vazquez Unidad 5 - Cap XXI Costos para La Toma de DecisionesLuciana GodoyNo ratings yet

- Costos para EmpresasDocument17 pagesCostos para EmpresasCristhian Silupu CastilloNo ratings yet

- Examen Parcial: Curso: Costos Profesor: Dr. Gerardo Gómez Jacinto Apellidos y NombresDocument2 pagesExamen Parcial: Curso: Costos Profesor: Dr. Gerardo Gómez Jacinto Apellidos y NombresCristhian Silupu CastilloNo ratings yet

- GestionDocument98 pagesGestionanyelo1207No ratings yet

- El MonopsonioDocument5 pagesEl MonopsonioMarleny RamirezNo ratings yet

- Taller ED JDRS Tercer CorteDocument2 pagesTaller ED JDRS Tercer CorteandreaNo ratings yet

- Guía de Trabajo Análisis de RegresiónDocument4 pagesGuía de Trabajo Análisis de RegresiónEduardo José Mejía ValleNo ratings yet

- Analisis 3.3Document57 pagesAnalisis 3.3Yamile CastiblancoNo ratings yet

- Análisis Multivariado, RegresionesDocument6 pagesAnálisis Multivariado, RegresionesPerla FuerteNo ratings yet

- Lab Final FC17007Document19 pagesLab Final FC17007Mirella AllerimNo ratings yet

- Regresion LinealDocument41 pagesRegresion LinealGloria Liliana Peñuela LizarazoNo ratings yet

- Regresión y correlación: Ejercicios de ajuste de modelos y análisis de resultadosDocument2 pagesRegresión y correlación: Ejercicios de ajuste de modelos y análisis de resultadosasdNo ratings yet

- PLAN CURRICULAR ANUAL DE MATEMÁTICAS 3BGUDocument10 pagesPLAN CURRICULAR ANUAL DE MATEMÁTICAS 3BGUAlexanderGonzalezNo ratings yet

- Clasificación Con Análisis DiscriminanteDocument169 pagesClasificación Con Análisis DiscriminanteAmirmktNo ratings yet

- MEMICUDocument5 pagesMEMICUWendy Medina0% (1)

- Ancova 2022Document30 pagesAncova 2022Erick Montiel BarreraNo ratings yet

- Cesareas en Mexico Aspectos Sociales Economicos y EpidemiologicosDocument161 pagesCesareas en Mexico Aspectos Sociales Economicos y EpidemiologicosD Ivette Santiago FloresNo ratings yet

- Tema 4 Anal Is Is Dos VariablesDocument5 pagesTema 4 Anal Is Is Dos VariablesKatherineRocioBedoyaLuzaNo ratings yet

- Sesión 8Document30 pagesSesión 8Jany Mayta QquerarNo ratings yet

- Análisis de confiabilidad e ingeniería de mantenimientoDocument165 pagesAnálisis de confiabilidad e ingeniería de mantenimientoLeidy Alejandra Urquijo PastranaNo ratings yet

- Artículo-Escurrimiento Diario, Mesual, Anual y MedioDocument12 pagesArtículo-Escurrimiento Diario, Mesual, Anual y Medioeli camposNo ratings yet

- Msad01 U2 MC2Document33 pagesMsad01 U2 MC2mariposaselevandoseNo ratings yet

- Facultad de IngenieríaDocument9 pagesFacultad de IngenieríaSolay A. Flores PinedoNo ratings yet

- Tarea-2 Control de Procesos PDFDocument14 pagesTarea-2 Control de Procesos PDFCristianCastilloChamorroNo ratings yet

- Econometría - 11 - 2022 - 1Document27 pagesEconometría - 11 - 2022 - 1fernandoNo ratings yet

- 2.problemario y FormularioDocument25 pages2.problemario y FormularioMAURICIO ROBLEDO HERNáNDEZNo ratings yet

- Taller NF 2 Pronóstico y Proyecciones en Excel VALERIA HERNANDEZDocument21 pagesTaller NF 2 Pronóstico y Proyecciones en Excel VALERIA HERNANDEZKarina Cardozo AriasNo ratings yet

- UNIDAD VI - Regresión Lineal 2018Document24 pagesUNIDAD VI - Regresión Lineal 2018celesteNo ratings yet

- Administracion de Operaciones Eje 2Document10 pagesAdministracion de Operaciones Eje 2Danny Diaz D0% (1)

- Carla - Perez TareaS8Document8 pagesCarla - Perez TareaS8Carla Perez100% (1)

- Produccion de Sulfato de AluminioDocument46 pagesProduccion de Sulfato de AluminioJuan Pablo Gamarra GutierrezNo ratings yet

- Kevin Israel Villarreal Morillo Estadistica InferencialDocument13 pagesKevin Israel Villarreal Morillo Estadistica InferencialAnthon JazmanyNo ratings yet

- Correlación y regresiónDocument42 pagesCorrelación y regresiónAlejandro Vera BocanegraNo ratings yet

- Medidas Estadísticas Bivariantes de - 202346 - 73442Document1 pageMedidas Estadísticas Bivariantes de - 202346 - 73442melissa berrio reyesNo ratings yet

- ESTADISTICA RegresionDocument21 pagesESTADISTICA RegresionEstefani Inquillay CardenasNo ratings yet